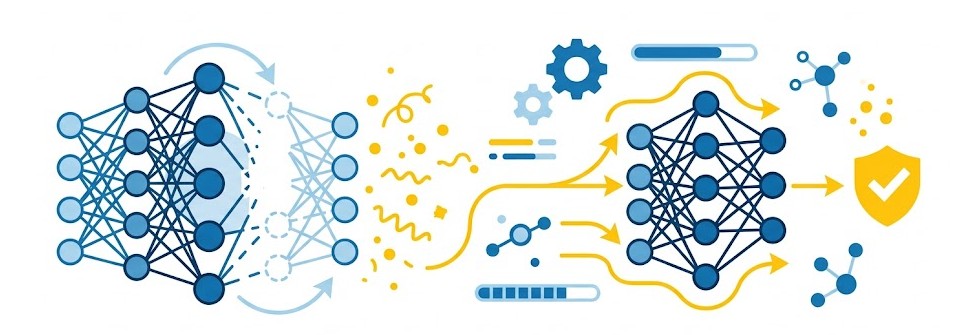

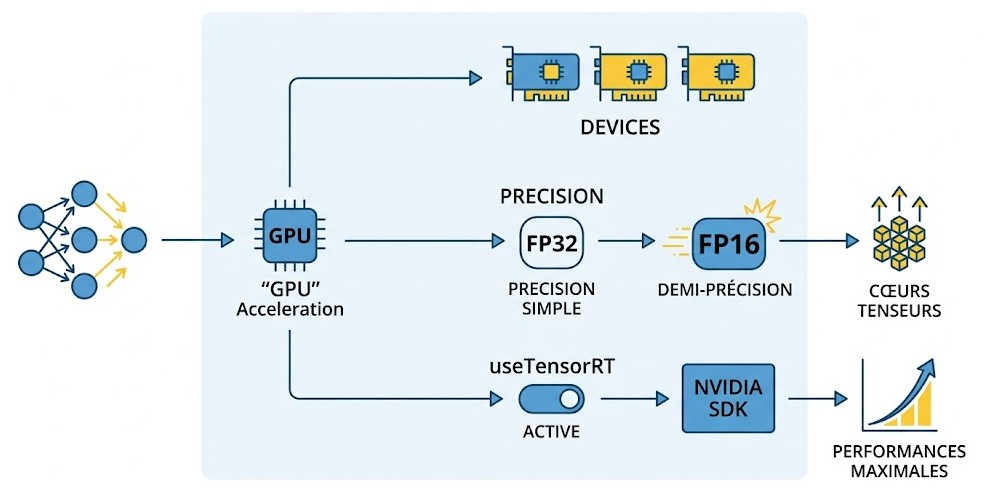

Pour maximiser les performances de l'élagage, l'architecte Data peut exploiter le paramètre gpu. Ce bloc permet de cibler des architectures matérielles graphiques spécifiques via devices. Vous pouvez finement régler la précision mathématique avec le sous-paramètre precision en choisissant FP16 pour activer la demi-précision (idéal pour engager les cœurs tenseurs et accélérer l'entraînement) ou FP32 pour une précision simple standard. De plus, l'activation du booléen useTensorRT permet de mobiliser le SDK d'inférence ultra-rapide de NVIDIA pour des performances maximales.

Quels sont les leviers d'accélération GPU disponibles lors de la réduction des couches de réseaux de neurones ?

Optimisation GPU pour l'Élagage Deep Learning

Exemples pour l'action dlPrune

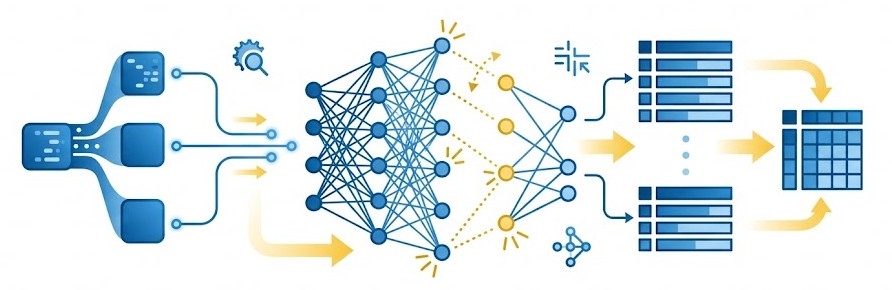

Élagage basique d'une couche convolutive

Exemple rudimentaire ciblant une seule couche pour l'alléger en s'appuyant sur des poids préalablement entraînés.

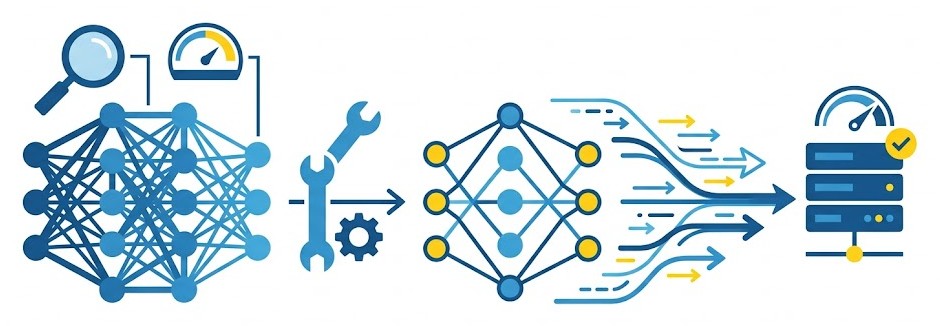

Élagage avancé avec suivi et accélération GPU

On élague plusieurs couches avec une tolérance d'erreur spécifique, en activant l'accélération matérielle et le retour détaillé des métriques d'ajustement.