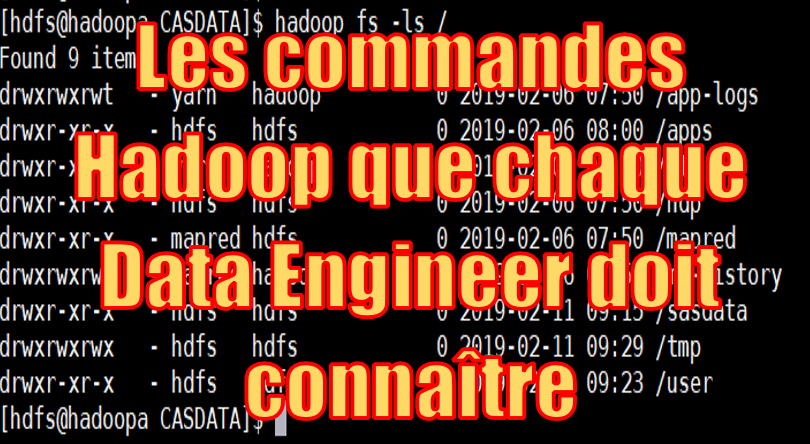

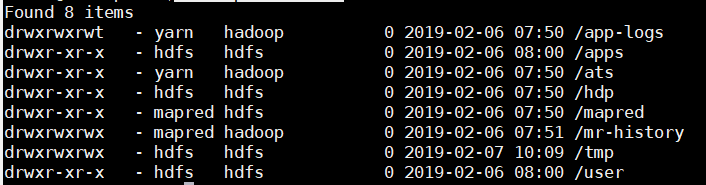

Depuis une machine cliente :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -ls hdfs://namenodeHadoop:10001/

Créer un répertoire HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -mkdir /sasdata

Depuis une machine cliente :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -ls hdfs://namenodeHadoop:10001/

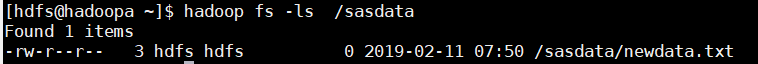

Créer un répertoire HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -mkdir /sasdata

Créer un fichier

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -touchz /sasdata/newdata.txt

Créer un fichier

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -touchz /sasdata/newdata.txt

Supprimer un fichier sur HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -rm /temp.txt

Supprimer un répertoire HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -rmr /monRep

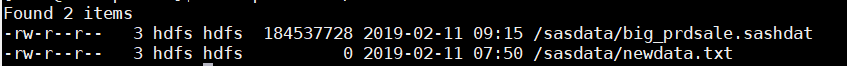

Copier des fichiers ou des dossiers du système local vers HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -copyFromLocal /home/hdfs/sasdata/CASDATA/NFS/big_prdsale.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /sasdata

Supprimer un fichier sur HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -rm /temp.txt

Supprimer un répertoire HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -rmr /monRep

Copier des fichiers ou des dossiers du système local vers HDFS

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -copyFromLocal /home/hdfs/sasdata/CASDATA/NFS/big_prdsale.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /sasdata

Définition de la réplication et de la taille du bloc lors de l'upload

La taille de bloc par défaut dans les datanodes hdfs est de 64 Mo. Mais vous pouvez augmenter à 128 ou 256mb selon vos besoins.

Le facteur de réplication est 3 par défaut, mais vous pouvez également l'augmenter.

Facteur de réplication :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -D dfs.replication=1 -put /home/hdfs/sasdata/CASDATA/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /tmp

hdfs dfs -stat %r /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).

Ce qui donne 1

Block Size :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -D dfs.block.size=2939392 -cp file:/home/hdfs/sasdata/CASDATA/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -stat "%F %u:%g %b %y %n - replication : %r - block size : %o" /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).

Définition de la réplication et de la taille du bloc lors de l'upload

La taille de bloc par défaut dans les datanodes hdfs est de 64 Mo. Mais vous pouvez augmenter à 128 ou 256mb selon vos besoins.

Le facteur de réplication est 3 par défaut, mais vous pouvez également l'augmenter.

Facteur de réplication :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -D dfs.replication=1 -put /home/hdfs/sasdata/CASDATA/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /tmp

hdfs dfs -stat %r /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).

Ce qui donne 1

Block Size :

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -D dfs.block.size=2939392 -cp file:/home/hdfs/sasdata/CASDATA/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping). /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).

hadoopFramework open-source permettant le stockage distribué (HDFS) et le traitement de données massives sur des clusters de serveurs, souvent utilisé avec SAS Viya pour l'analyse Big Data. fs -stat "%F %u:%g %b %y %n - replication : %r - block size : %o" /tmp/customers.sashdatSASHDAT est le format de fichier propriétaire de SAS Viya optimisé pour Cloud Analytic Services (CAS). Il permet un chargement ultra-rapide des données en mémoire via un accès direct (memory-mapping).