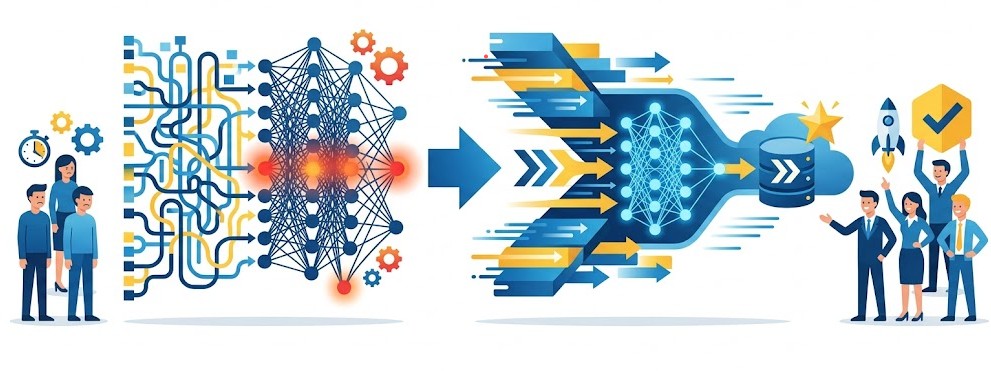

La prévention du surapprentissage, ou overfittingSurapprentissage d'un modèle mémorisant le bruit des données d'entraînement au lieu des tendances, réduisant ainsi sa capacité de généralisation et sa précision sur de nouvelles observations., est la pierre angulaire d'un modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). d'intelligence artificielle robuste. Avec l'action dlTrain, votre meilleure ligne de défense est l'utilisation combinée des paramètres validTable et bestWeights. En soumettant une table de validation parallèle à vos données d'entraînement, le système évalue la perte de généralisation à chaque itération. Au lieu de conserver aveuglément les poids finaux qui pourraient être sur-entraînés, le système sauvegardera automatiquement la configuration optimale dans la table spécifiée par bestWeights. En complément, vous pouvez activer l'abandon aléatoire de neurones avec le paramètre dropout ou ajouter une pénalité mathématique stricte sur la complexité du réseau via les options regL1 et regL2.

Quelle est la stratégie absolue pour éradiquer le surapprentissage de vos modèles de Deep Learning ?

Maîtrise de la convergence : Le couple ValidTable & BestWeights

Exemples pour l'action dlTrain

Entraînement basique d'un modèle DNN

Ce code entraîne le modèle 'iris_model' avec les paramètres par défaut de l'optimiseur.

Entraînement avancé avec algorithme ADAM et sauvegarde des meilleurs poids

Entraînement utilisant l'optimiseur ADAM, avec des logs détaillés et la sauvegarde des poids optimaux, en s'arrêtant plus tôt si stagnation.