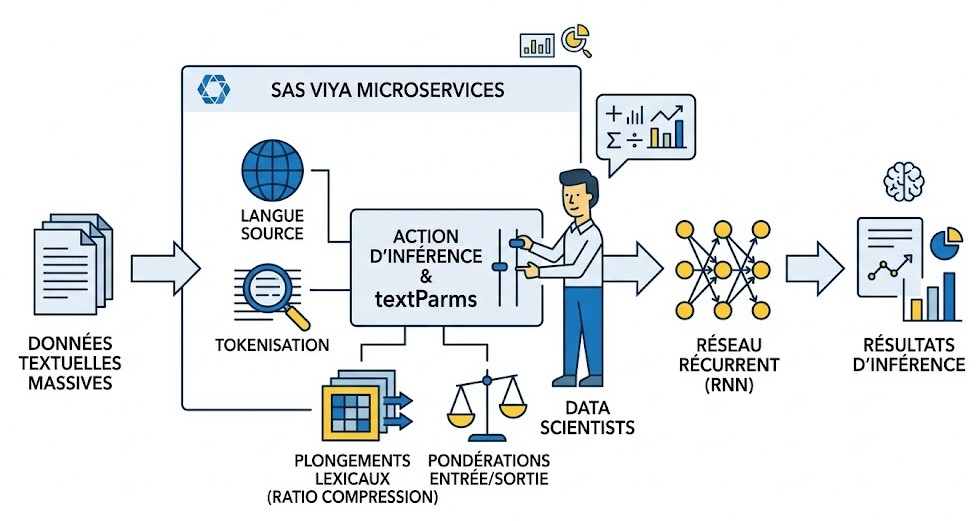

Le traitement analytique du langage naturel nécessite des transformations matricielles très spécifiques avant l'évaluation par un réseau récurrent. L'action intègre à cet effet le puissant ensemble de paramètres textParms qui encapsule toutes les directives d'ingénierie textuelle. Ce module permet aux data scientistsExperts extrayant des connaissances via des méthodes statistiques, algorithmes et IA. Ils transforment les données brutes en insights stratégiques pour résoudre des problèmes métier complexes. de définir le ratio de compression pour les plongements lexicaux, d'associer des tables de pondérations spécifiques pour les encodages d'entrée et de sortie, et de configurer la langue source pour garantir une tokenisation irréprochable. L'ensemble de cette orchestration linguistique se déroule de façon distribuée au sein des microservicesLes microservices sont une approche d'architecture logicielle où une application est décomposée en une collection de petits services indépendants, spécialisés et communicant entre eux via des APIs légères. Contrairement aux architectures "monolithiques" anciennes, chaque microservice remplit une fonction unique (ex: gestion du catalogue, authentification, moteur de calcul).

Dans SAS Viya 4, cette architecture est native. Elle permet à la plateforme de s'exécuter sur Kubernetes, offrant une flexibilité totale : chaque composant de SAS peut être mis à jour, redémarré ou mis à l'échelle (scaling) individuellement sans affecter le reste du système. de l'architecture SAS Viya.

Quels sont les mécanismes techniques intégrés pour propulser l'inférence sur des flux massifs de données textuelles non structurées ?

Inférence de Haute Performance pour le NLP

Exemples pour l'action dlScore

Scoring simple d'un modèle de Deep Learning

Cet exemple illustre l'usage minimal de dlScore en fournissant les données d'entrée, le modèle, ses poids, et la table de sortie.

Scoring optimisé sur GPU avec extraction de variables et Top-K

Ce scénario avancé montre comment effectuer le scoring sur un GPU, copier la colonne d'identifiant depuis la table d'entrée, et ne garder que le top 3 des probabilités de classification.

Extraction des caractéristiques profondes (Feature Extraction)

Utile pour le Transfer Learning : cet exemple score les données mais sauvegarde également les activations internes d'une couche cachée spécifique (ex: 'FC1') dans la table layerOut.