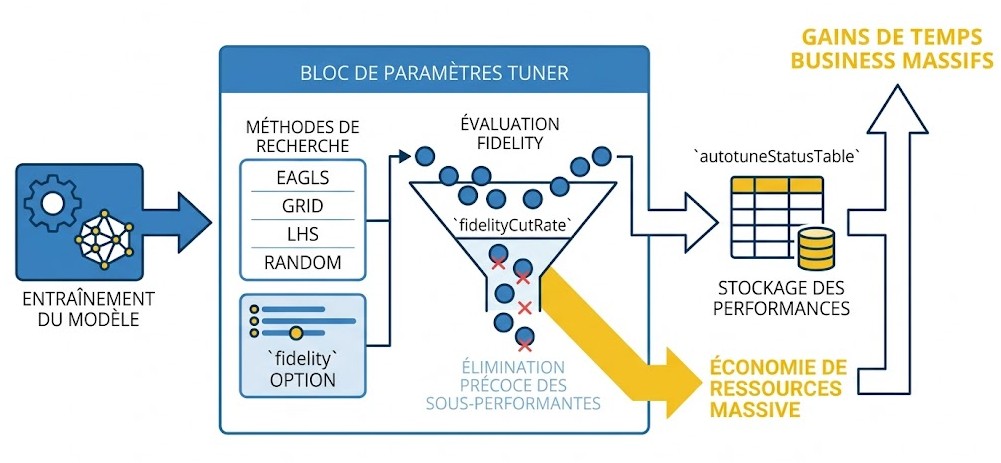

Absolument. L'action propose le bloc de paramètres tuner qui supporte plusieurs méthodes de recherche pour l'hyper-paramétrage telles que EAGLS, GRID, LHS et RANDOM. De plus, elle intègre une option fidelity qui permet d'utiliser une approche d'évaluation basée sur la fidélité. Cela permet d'éliminer de manière précoce les configurations sous-performantes en fonction d'un taux de coupure défini par fidelityCutRate, économisant ainsi des ressources de calcul massives. Les performances sont ensuite stockées dans une table globale spécifiée par autotuneStatusTable.

Est-il possible d'automatiser la recherche des meilleurs hyperparamètres pendant l'entraînement du modèle pour un gain de temps business ?

Optimisation de l'Hyper-paramétrage (Autotuning)

Exemples pour l'action dlmztrain

Entraînement basique d'un modèle de Deep Learning

Cet exemple montre comment lancer un entraînement simple avec l'optimiseur ADAM sur 5 époques à partir de données d'images.

Entraînement avancé avec Validation, accélération GPU et Arrêt Prématuré

Ici on sort l'artillerie lourde : utilisation de GPU multiples, d'un jeu de validation croisée, de l'optimiseur SGD avec momentum, et d'un mécanisme d'arrêt prématuré (Early Stopping) si la perte de validation stagne pendant 3 époques consécutives.