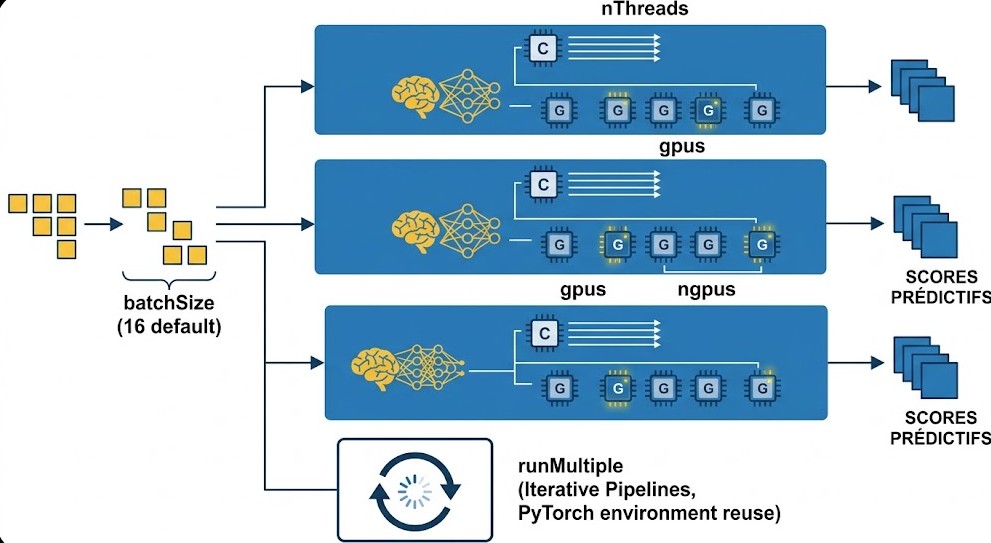

Pour des performances extrêmes, l'architecture vous donne accès à plusieurs paramètres d'orchestration matérielle. Le paramètre batchSize (configuré à 16 par défaut) détermine le nombre d'observations traitées par chaque nœud d'exécution. L'accélération matérielle est entièrement pilotable via gpus pour allouer des périphériques spécifiques et ngpus pour définir la volumétrie graphique. Côté processeur, nThreads gère le parallélisme CPU. Enfin, pour des pipelines de scoringProcessus d'application d'un modèle prédictif à de nouvelles données pour calculer une probabilité ou un score, permettant ainsi d'automatiser la prise de décision en temps réel sur SAS Viya. itératifs, l'activation de runMultiple évite le coût de réinitialisation de l'environnement PyTorchPyTorch est un framework open source d'apprentissage profond (Deep Learning) facilitant la création de graphes de calcul dynamiques et l'entraînement de modèles de réseaux de neurones complexes. à chaque appel.

Quels sont les leviers techniques pour maximiser la vitesse de scoring sur des environnements multi-noeuds et GPU ?

Optimisation du Scoring Ultra-Haute Performance

Exemples pour l'action dlmzScore

Scoring basique

Utilisation de dlmzScore avec les paramètres obligatoires pour obtenir les prédictions d'un modèle entraîné.

Scoring avancé avec accélération matérielle et options YAML

Un exemple de configuration exhaustive pour des performances maximales : distribution des données, utilisation de 2 GPUs, multi-threading et options YAML personnalisées.