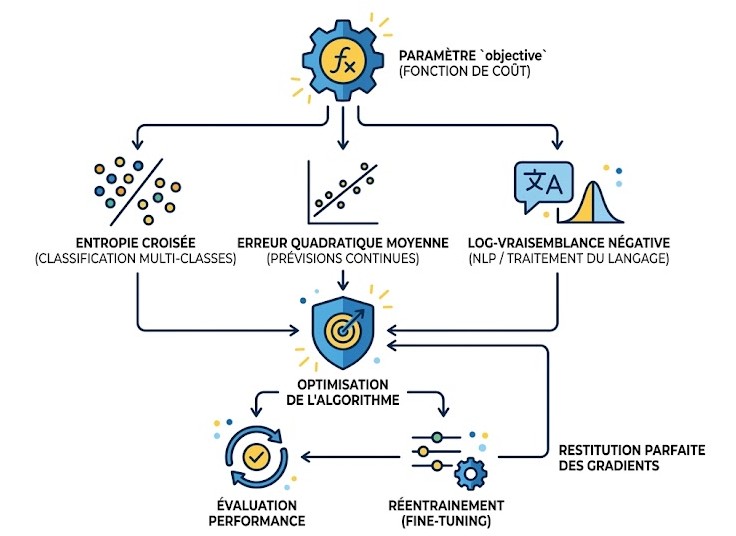

Pour que le modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). exporté conserve une compréhension exacte de ce qu'il tente de prédire, il doit retenir sa fonction d'optimisation mathématique. Le paramètre objective définit le cœur de cette stratégie en spécifiant la fonction de perte (ou fonction de coût) associée au réseau.

- L'entropie croisée (valeur par défaut) : l'approche standard et incontournable pour résoudre les problèmes de classification multi-classes complexe.

- L'erreur quadratique moyenne : le choix mathématique optimal pour les prévisions continues, l'estimation de valeurs et les problématiques de régression pure.

- La perte de log-vraisemblance négative : une fonction très prisée dans le traitement du langage naturel, fonctionnant souvent en synergie avec des couches d'activation probabilistes terminales.

Un paramétrage correct de cet argument assure une restitution parfaite des gradients lors d'éventuels processus de réentraînement (Fine-Tuning) ou d'évaluation de la performance.