L'architecture SAS Viya prévoit la gestion des données textuelles massives de manière très élégante via le bloc de paramètres textParms. Lors de l'export de modèles récurrents ou de réseaux profonds orientés traitement du langage naturel (NLPTraitement automatique du langage naturel visant à permettre aux machines de comprendre, d'interpréter et de générer du texte ou de la parole de manière cohérente et structurée.), vous pouvez y spécifier des options avancées comme initInputEmbeddings ou initOutputEmbeddings. Ces configurations permettent d'attacher et de compresser (notamment en utilisant le réglage embeddingsCompressionRatio) de vastes matrices de plongements lexicaux (Word Embeddings) directement dans le package du modèleReprésentation mathématique entraînée sur des données pour capturer des tendances, prédire des résultats ou classifier des observations via des algorithmes (Régression, Forêt aléatoire, Gradient Boosting). exporté. Cela garantit une inférence totalement autonome, auto-suffisante et extrêmement performante, sans nécessiter de jointures coûteuses avec des bases de données externes lors de la phase de production.

Comment embarquer efficacement les immenses espaces vectoriels textuels lors de l'export d'un modèle NLP complexe ?

Optimisation des Embeddings avec textParms

Exemples pour l'action dlExportModel

Export standard d'un modèle

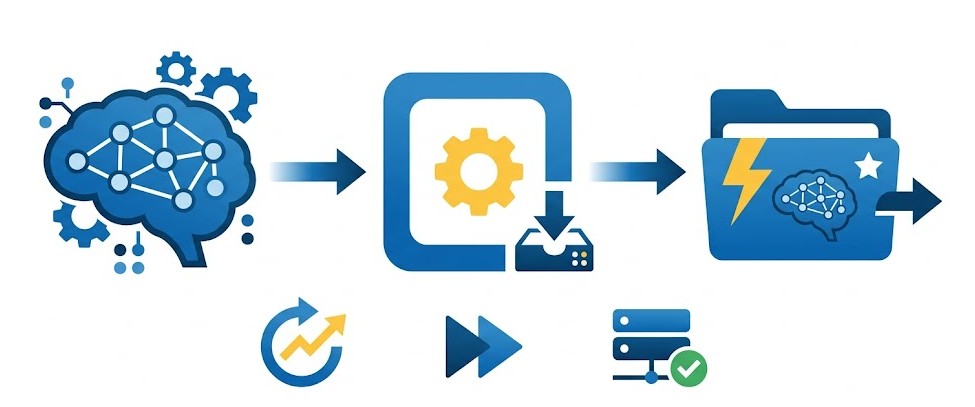

Cet exemple prend un modèle préalablement construit et entraîné, et l'exporte en ASTORE pour le déploiement ou l'inférence.

Export d'un modèle d'analyse d'images avec data augmentation

On exporte un réseau de neurones convolutif (CNN) en lui incluant des directives de mutation et de recadrage aléatoire. C'est parfait pour garantir des scores plus résilients aux variations %%importOptions%%.