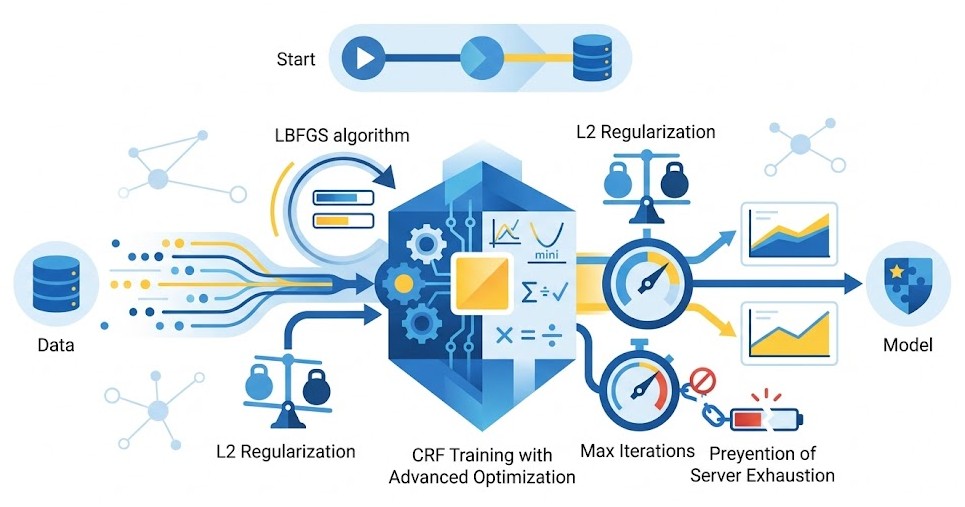

Le choix du solveur d'optimisation dans le paramètre nloOpts impacte directement les performances en environnement distribué. Par défaut, l'action utilise LBFGS, qui est particulièrement performant pour converger avec un minimum d'itérations en s'appuyant sur l'historique des gradients. Toutefois, si vos plans de données impliquent des matrices de très haute dimensionnalité, les algorithmes SGD (Stochastic Gradient Descent) ou ADAM sont recommandés. Ils opèrent via des mini-lots de données, ce qui allège considérablement la pression sur l'empreinte mémoireGemini said

Espace de stockage temporaire (RAM) utilisé par le moteur CAS pour charger et traiter les données à haute vitesse, minimisant les accès disque pour optimiser les performances de SAS Viya. des nœuds de calcul.

LBFGS, SGD ou ADAM : quel algorithme de machine learning choisir pour booster votre optimisation ?

Optimisation Distribuée sur SAS Viya 4

Exemples pour l'action crfTrain

Entraînement CRF basique

Découvrez cet exemple pour l'action CAS crfTrain : il initialise un apprentissage supervisé par champs aléatoires conditionnels via un fenêtrage local ([-1,0] à [1,0]) pour extraire les features.

Entraînement CRF avec Optimisation Avancée

Découvrez cet exemple pour l'action CAS crfTrain : il optimise un modèle CRF via LBFGS avec régularisation L2 et contrôle de convergence (fConv), assurant une extraction d'entités stable et performante.