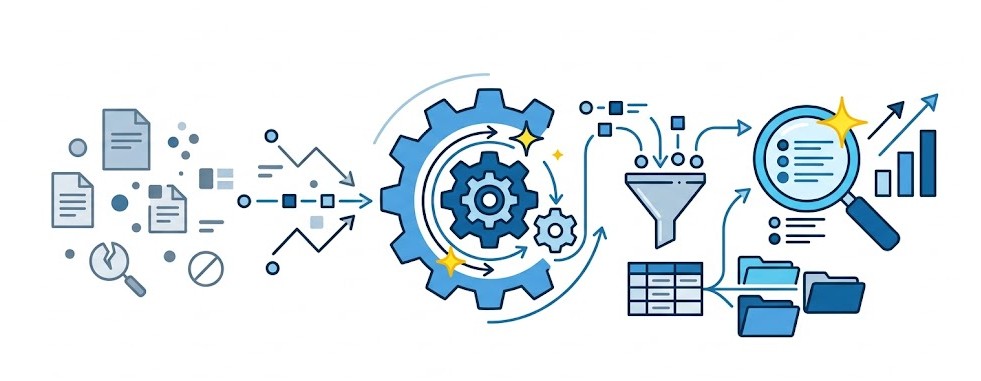

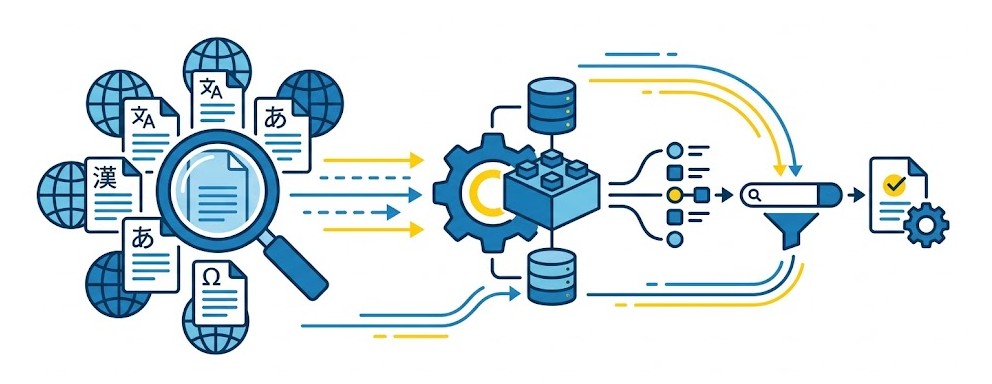

Le paramètre tokenize agit comme un levier de précision pour le traitement automatique du langage naturel. Lorsqu'il est activé via la valeur TRUE, l'action ne se contente plus d'indexer des chaînes de caractères brutes ; elle décompose le texte en unités lexicales élémentaires appelées tokensÉléments de données atomiques (mots, codes) extraits d'une chaîne brute par la QKB pour être analysés, standardisés ou validés individuellement lors des processus de Data Quality.. Cette décomposition permet une analyse beaucoup plus fine, capable de distinguer et de comptabiliser chaque mot de manière isolée au sein d'un document. Pour les entreprises gérant des volumes importants de données non structurées, l'activation de la tokenisation est impérative pour garantir que les termes extraits reflètent réellement le contenu sémantique du corpus, optimisant ainsi les plans de données pour des analyses ultérieures plus poussées.

Comment le paramètre de tokenisation transforme-t-il la précision de vos analyses textuelles ?

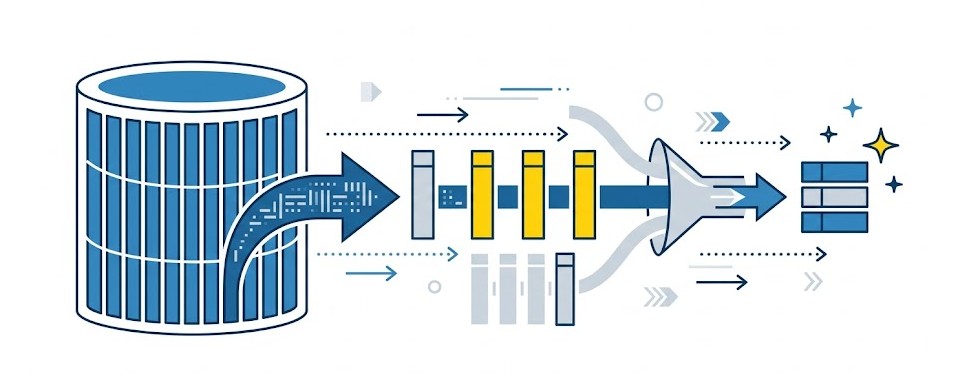

Optimisation du moteur d'indexation linguistique

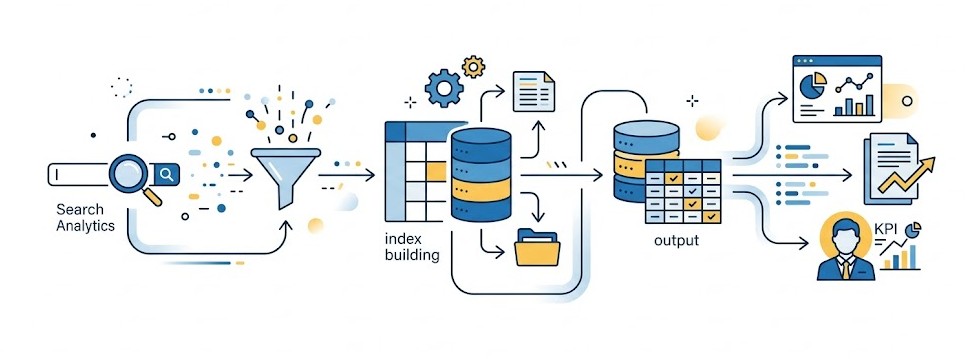

Exemples pour l'action buildTermIndex

Extraction de base des termes

Ce code crée une table simple contenant tous les termes trouvés dans la table d'entrée.

Extraction avancée avec segmentation en Français

Ici, on spécifie que le texte est en français, on active la segmentation et on cible une colonne précise.