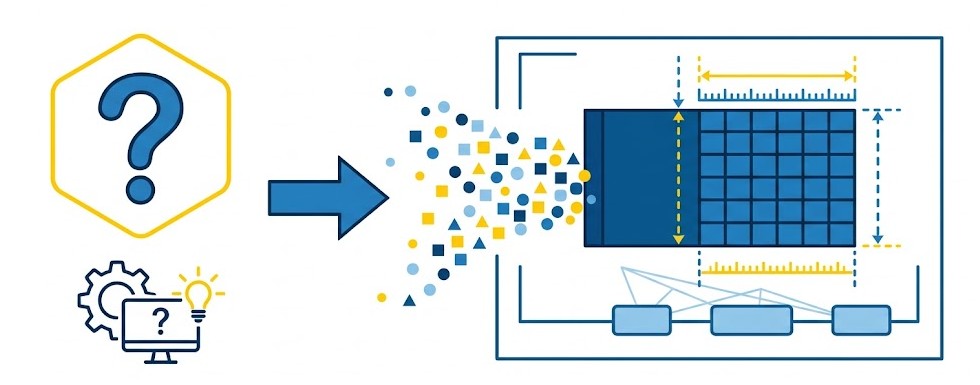

Une couche récurrente de type RECURRENT est utilisée pour traiter des séquences. Les paramètres principaux sont :

n: Nombre de neurones dans la couche (obligatoire, minimum > 0).rnnType: Type de réseau de neuronesUn réseau de neurones est un modèle d'IA bio-inspiré composé de couches de nœuds interconnectés, capable d'apprendre des relations complexes dans les données pour prédire ou classifier avec précision. récurrent (par défautRNN) :- GRU : Gated Recurrent Unit.

- LSTM : Long Short-Term Memory unit.

- RNNRéseau de neurones récurrent conçu pour les données séquentielles. Il utilise des boucles de rétroaction pour mémoriser l'information passée, idéal pour l'analyse de texte ou de séries temporelles. : Réseau de neuronesUn réseau de neurones est un modèle d'IA bio-inspiré composé de couches de nœuds interconnectés, capable d'apprendre des relations complexes dans les données pour prédire ou classifier avec précision. récurrent simple.

outputType: Type de sortie de la couche RNNRéseau de neurones récurrent conçu pour les données séquentielles. Il utilise des boucles de rétroaction pour mémoriser l'information passée, idéal pour l'analyse de texte ou de séries temporelles. (par défautENCODING) :- ARBITRARYLENGTH : Génère une séquence de longueur arbitraire.

- ENCODING : Génère un vecteur de longueur fixe.

- SAMELENGTH : Génère une séquence de même longueur que l'entrée.

maxOutputLength: Longueur maximale de la séquence de sortie sioutputTypeestARBITRARYLENGTH(entre 1 et 100000).reversed(aliasreverse) : Indique si la séquence est traitée dans l'ordre inverse (FALSEpar défaut).dropout: Taux de dropout (par défaut 0, entre 0 et 1 exclus).init: Schéma d'initialisation des poids (voir options d'initialisation).mean: Valeur moyenne pour l'initialisationNORMAL(par défaut 0).std: Écart-type pour l'initialisationNORMAL(par défaut 1).truncationFactor(aliastruncFact) : Seuil de troncature pour l'initialisationNORMAL(par défaut 0, minimum 0).act: Fonction d'activation (voir options de fonctions d'activation).fcmpAct: Fonction d'activation FCMPProcédure de création de fonctions et sous-programmes personnalisés réutilisables. Elle permet d'étendre le langage SAS et de partager des logiques métier complexes entre différentes étapes DATA. personnalisée.